Single-Player oder Multi-Player: Welche KI-Architektur baut deine Organisation gerade?

Single-Player oder Multi-Player: Welche KI-Architektur baut deine Organisation gerade?

icon

password

LinkedIn-Post erstellen

LinkedIn Post

type

Post

status

Published

date

Apr 15, 2026

slug

ki-solo-vs-multiplayer

summary

KI-Agenten verändern die Arbeitswelt. Doch was passiert, wenn Individuen in isolierten Kontexten agieren? Ist das der Fortschritt, den wir uns erhofft haben?

tags

Transformation

Agent

Kultur

category

human-ai

Seiten-URL

https://ai.growhuman.io/article/ki-solo-vs-multiplayer

Bild-URL

Persistente Bild-URL

🖼️ Bilder erstellen

Source-URL

created_at

LinkedIn Post 1

Bild-Prompt

AI summary

Bild-Idee

Der Cowork-Moment

Es gibt diesen Moment, in dem man eine neue Software öffnet und merkt: Das hier ist anders. Nicht graduell besser, sondern eine neue Dimension.

So ein Moment war es, als Tools wie Claude Cowork zeigten, was agentisches Arbeiten konkret bedeutet.

Kein Chat mehr, kein Kopieren von Kontexten in ein Eingabefeld und zurück. Stattdessen: Aufgaben delegieren. Dateien übergeben. Ergebnisse zurückbekommen. Vom Fragen zum Beauftragen.

Das ist ein echter Fortschritt. Und er lohnt es, klar anerkannt zu werden.

Aber er hat eine Kehrseite, über die aktuell zu wenig gesprochen wird.

Ein Tool, das auf einer Person endet

Claude Cowork läuft lokal. Es hat Zugriff auf die Dateien einer einzelnen Person, auf deren Projekte, auf deren Kontext. Die Instruktionen, die Memory-Daten, der Workflow – alles hängt an einem Account, einem Rechner, einem Menschen. Das ist kein Fehler im Design. Es ist das Design.

Und genau das ist das Problem.

Denn Wissensarbeit in Organisationen ist selten eine Soloaufgabe. Strategiepapiere entstehen in Abstimmung. Entscheidungen brauchen Freigaben. Dokumente wechseln Hände, bevor sie final werden. Der echte Arbeitsalltag ist – trotz aller Produktivitäts-Individualisierung – im Kern kollaborativ.

Die Cloud-Tools der letzten zehn Jahre haben genau das abgebildet: Google Docs, Microsoft 365, Figma, Notion. Gleichzeitiges Editieren. Kommentare, die an Textstellen hängen. Geteilter Kontext. Versionshistorie. KI-Agentensysteme wie Claude Cowork ziehen die Arbeit gerade zurück auf den lokalen Rechner – ein Paradigma, das diese Tools gerade überwunden hatten.

Das steckt im Tool-Design drin

Tom Kerwin und Corissa Nunn, Autoren des Newsletters The Reach, haben das kürzlich auf den Punkt gebracht: Sie analysieren einen Artikel von Anthropics Head of Product – und stoßen auf etwas Aufschlussreiches. Das, was dort als „Collaboration" beschrieben wird, ist bei genauerem Hinsehen Soloarbeit. Eine Person, die alle Rollen trägt. Sie schreiben: „It's one person wearing every hat, like a Bugs Bunny cartoon where Bugs plays all the characters."

Noch schärfer ist ihre Beobachtung zum Kern des Problems: „The value wasn't ever in the artefacts themselves in the first place. It was in the friction you meet along the way. It was in the way that friction shapes and travels through relationships and interactions in the social substrate of an organisation – enabling reorientation."

Das ist die eigentliche Diagnose. KI-Agentensysteme entfernen Reibung. Sie beschleunigen die Artefaktproduktion. Aber die Reibung zwischen Menschen – das Aushandeln, das Missverstehen, das Korrigieren – war nie nur Ineffizienz. Sie war der Stoff, aus dem gemeinsames Verstehen entsteht.

Und Kerwin und Nunn stellen eine These auf, die das Tool-Design grundsätzlich betrifft: Die Werkzeuge werden von Menschen gebaut, die in einer bestimmten Logik denken – der Logik der Einzelentwickler*in. Eine Person, ein Codebase, ein Ergebnis. Der Gedanke, dass Wert aus dem Zusammenspiel vieler Menschen entsteht – aus Unklarheit, Diskussion, sozialer Aushandlung – ist in diese Architektur strukturell nicht eingebaut.

Der Entwickler-Blickwinkel prägt das Bild

Die Coding-Welt hat ein funktionierendes Kollaborationsmodell: Git-Repositories, Pull Requests, Code Reviews, geteilte Instruktionsdateien. Mehrere Personen, mehrere KI-Agentensysteme, ein gemeinsames Repository.

Das funktioniert gut – für Code. Für versionierbare Textdateien. Für strukturierte Artefakte, die sich zusammenführen lassen.

Für den Rest der Wissensarbeit – Abstimmungsmails, Strategie-Workshops, Planungsrunden, Entscheidungsdokumente – ist dieses Modell schlicht nicht übertragbar. Die Lernkurve ist zu steil. Echtzeit-Co-Editing gibt es nicht. Die soziale Schicht fehlt.

Dazu kommt ein strukturelles Anreizproblem, das John Cutler in einer detaillierten Analyse beschrieben hat: Wenn jede Person ihre eigene KI-Umgebung optimiert, sinken die Anreize, Wissen aktiv zu teilen. Warum erklären, was die KI mir selbst schon beantwortet? Warum dokumentieren, wenn ich den Kontext selbst behalte? Der Status-Gewinn liegt beim Solo-Power-User. „Knowledge Curator fürs Team" ist kein Statusspiel, das jemand gewinnen will.

Die Forschung bestätigt, was sich in der Praxis zeigt

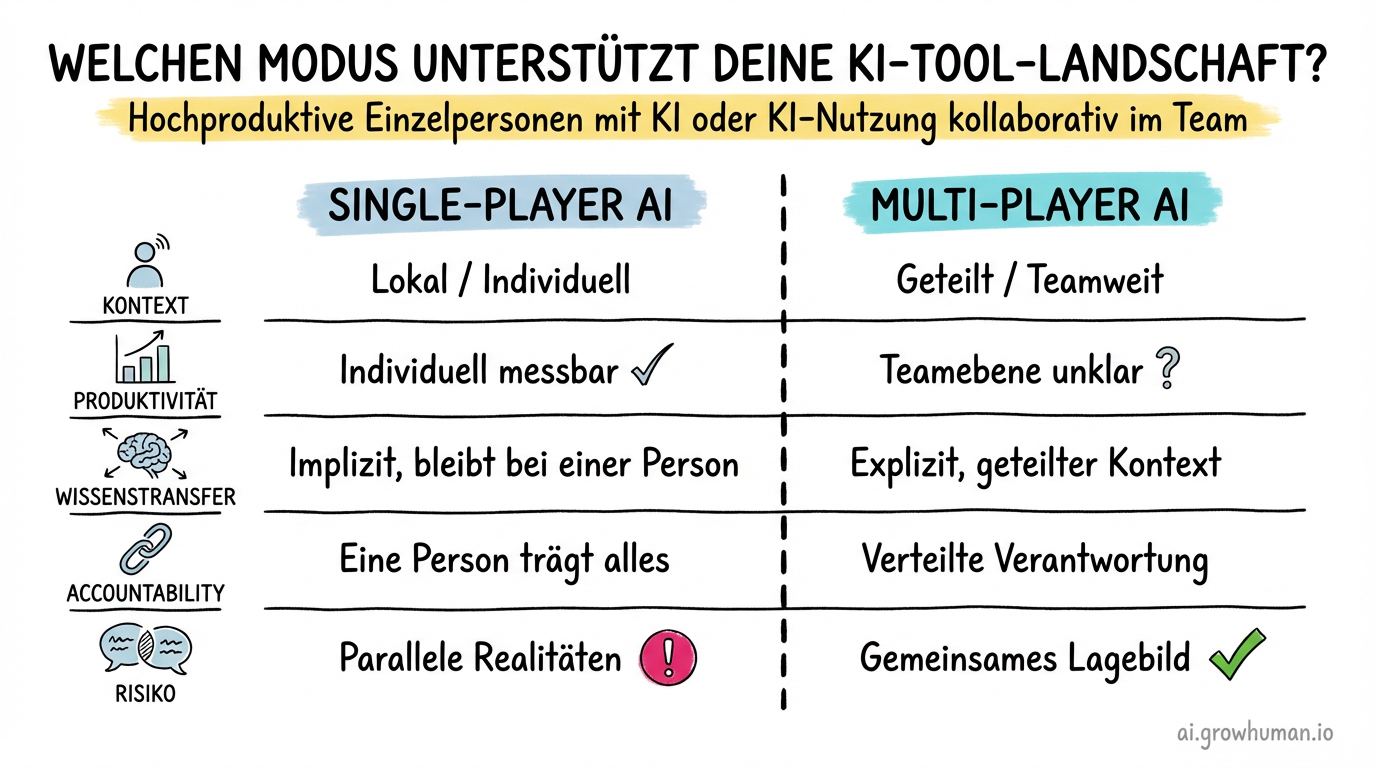

Der Microsoft New Future of Work Report 2025 liefert dazu klare Befunde. KI hat die Produktivität auf individueller Ebene messbar verbessert. Auf Teamebene ist das Bild deutlich unklarer.

Eine der zitierten Studien zeigt: Einzelpersonen mit KI-Unterstützung erreichen im Labor ähnliche Ergebnisse wie Teams ohne KI – gemessen an der Durchschnittsleistung. Was auf den ersten Blick wie ein Erfolg klingt, ist bei genauerem Hinsehen eine beunruhigende Beobachtung: Teams als Ganzes profitieren kaum.

Die Gründe dafür sind strukturell. KI-Sprachmodelle werden für Einzelinteraktionen trainiert – eine Person, eine Anfrage, eine Antwort. Die Konzepte, die Gruppenarbeit ausmachen – geteiltes Wissen, soziales Grounding, gemeinsames Situationsverständnis – sind nicht Teil des Standard-Trainings. Der Bericht formuliert es nüchtern: KI hat „relatively limited knowledge of critical social dynamics like (interpersonal) grounding."

Hinzu kommt ein Effekt, der organisationalen Lernkulturen besonders schaden kann: Wenn jede Person mit ihrer eigenen KI-Umgebung arbeitet, sinken die Anreize, Wissen aktiv zu teilen. Warum erklären, was die Maschine mir schon erklärt? Warum dokumentieren, wenn ich selbst den Kontext behalte?

Hollie Wegman, die über kollaborative KI schreibt, fasst das zusammen: „AI made individuals faster. It didn't make teams better. In fact, it often does the opposite. You get highly productive people working in slightly different realities."

Hochproduktive Einzelpersonen in leicht unterschiedlichen Realitäten

Das ist das Bild, das entsteht, wenn KI-Agentensysteme im Soloplayer-Modus in Organisationen eingeführt werden: Jede Person optimiert ihre eigene Arbeit. Die Abstimmungskosten zwischen diesen optimierten Einzelbereichen steigen. Das gemeinsame Verständnis erodiert.

In den Kommentaren unter Cutlers Analyse bringt es jemand auf den Punkt: „Multiplayer is defensible: it is a trust problem, not a capability problem. Claude can do the work. Claude cannot own the accountability chain. That is the moat.“

Das ist die entscheidende Unterscheidung. Nicht Können. Accountability.

Kerwin und Nunn bringen dazu den tiefsten Punkt: Die eigentliche Engpassgröße in Organisationen war nie die Geschwindigkeit der Artefaktproduktion. Sie ist – und bleibt – die Geschwindigkeit, mit der eine Organisation auf Basis dessen, was sie lernt, neu ausrichten kann. Prototypen können heute in einem Nachmittag entstehen. Aber was mit dem Lerninhalt aus diesem Prototyp passiert – ob er in jemandem Posteingang verblasst, während alle durch politische Aushandlung navigieren – das ist eine soziale Frage, keine technische.

Was das für Organisationen bedeutet

Die Frage ist nicht, ob KI-Agentensysteme in Organisationen ankommen. Das passiert bereits. Die Frage ist, welche Grundform sich dabei etabliert.

Wenn Organisationen jetzt nicht aktiv gestalten, entsteht eine Standardform, die niemand bewusst gewählt hat: hochproduktive Einzelpersonen, die in parallelen, nicht synchronisierten KI-Kontexten arbeiten. Bessere Individuen. Kein besseres Team.

Das ist nicht die Transformation, die sich die meisten Führungskräfte vorstellen, wenn sie über KI sprechen.

Der nächste Schritt – geteilte KI-Kontexte, gemeinsame Instruktionen, Team-Memory, kollaborative Workflows mit Agentensystemen als Teilnehmer – ist technisch keine Science Fiction. Einzelne Tools experimentieren damit bereits. Aber er passiert nicht von selbst.

Er braucht eine bewusste Entscheidung: Dass kollaborative KI-Ansätze in Organisationen genauso systematisch etabliert werden wie es die Cloud-Tools in den letzten zehn Jahren wurden. Dass die Infrastruktur nicht nur auf Einzelnutzer*innen optimiert wird, sondern auf Teams. Dass Governance, geteilter Kontext und Accountability von Anfang an mitgedacht werden.

Der Soloplayer-Modus war ein guter erster Schritt, um KI in die Anwendung zu bringen und Erfahrungen zu sammeln. Für eine Organisation darf er nicht der letzte sein.

Quellen

- Tom Kerwin and Corissa Nunn – „A Beef with Claude": https://reach.crownandreach.com/posts/a-beef-with-claude

- John Cutler – „Single-Player to Multiplayer AI" (LinkedIn, April 2026): https://www.linkedin.com/posts/johnpcutler_single-player-to-multiplayer-ai-analysis-ugcPost-7449897048323067905-BvLN

- Microsoft – New Future of Work Report 2025: aka.ms/nfw2025

- Hollie Wegman – „AI Isn’t Multiplayer“ (Substack, Dear Operator, April 2026): https://open.substack.com/pub/dearoperator/p/ai-isnt-multiplayer

- Anthropic – Claude Cowork Produktseite: anthropic.com

Loading...